OpenAI avstår larma kanadensisk polis trots att system flaggar användare för våldsplaner

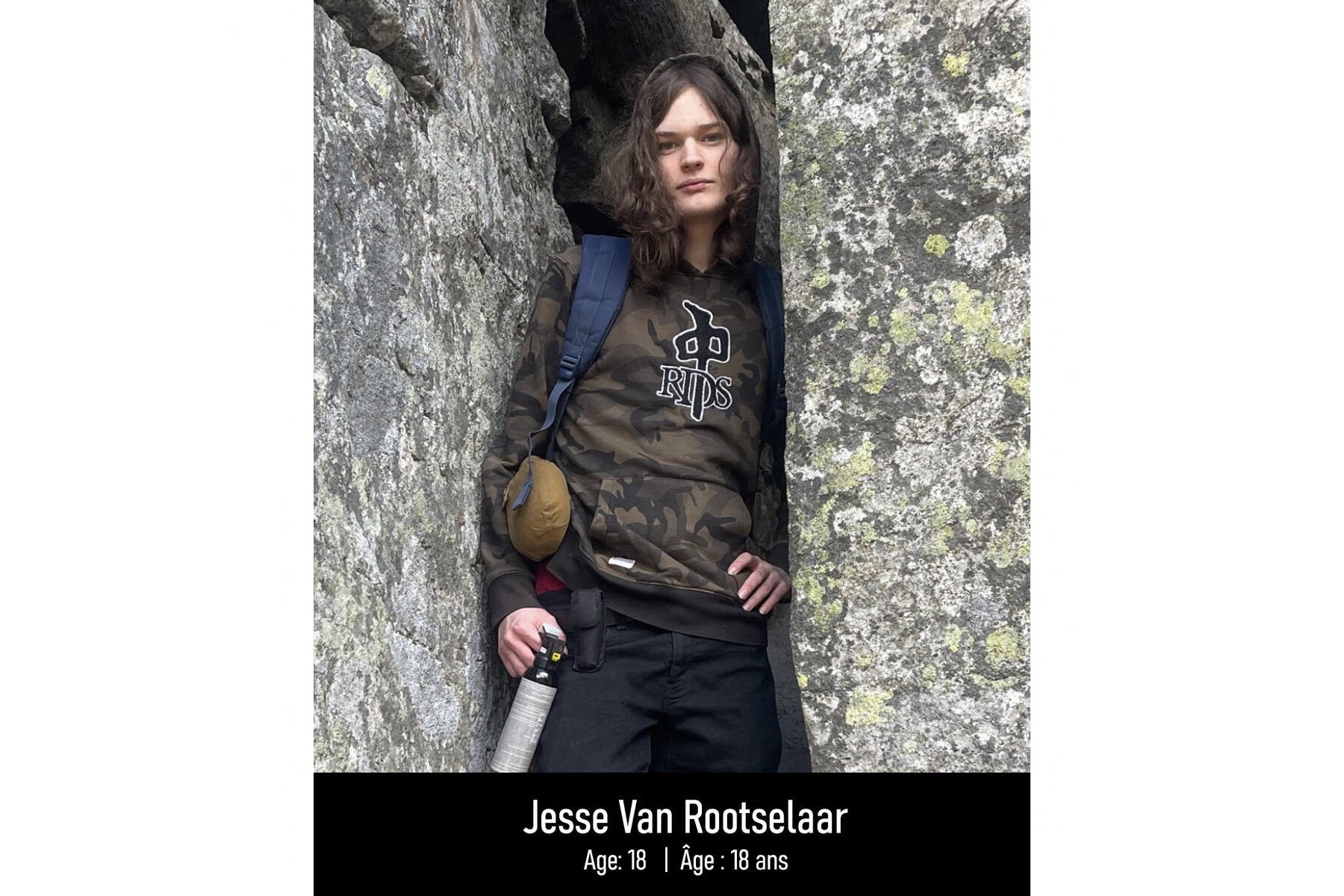

18-årige Jesse Van Rootselaar misstänks döda familj och skjuta på skola i British Columbia innan självmord, företaget bannlyser konto men kontaktar ridande polisen först efter dådet

Bilder

(Royal Canadian Mounted Police/AF)

Royal Canadian Mounted Police/AF

(Royal Canadian Mounted Police/AF)

Royal Canadian Mounted Police/AF

OpenAI faces lawsuit over ChatGPT triggering user's 'delusional spiral'

foxnews.com

OpenAI faces lawsuit over ChatGPT triggering user's 'delusional spiral'

foxnews.com

Police tape surrounds the Tumbler Ridge Secondary School and other buildings in Tumbler Ridge, B.C. on Wednesday, Feb. 11, 2026. (Jesse Boily /The Canadian Press via AP)

foxnews.com

Police tape surrounds the Tumbler Ridge Secondary School and other buildings in Tumbler Ridge, B.C. on Wednesday, Feb. 11, 2026. (Jesse Boily /The Canadian Press via AP)

foxnews.com

Students exit the Tumbler Ridge school after deadly shootings, in British Columbia, Canada, Tuesday Feb. 10, 2026. (Jordon Kosik via AP)

foxnews.com

Students exit the Tumbler Ridge school after deadly shootings, in British Columbia, Canada, Tuesday Feb. 10, 2026. (Jordon Kosik via AP)

foxnews.com

OpenAI uppger att bolaget under 2025 övervägde att larma kanadensisk polis efter att interna system markerat ett användarkonto för att främja våldsamma handlingar, men att man till slut avstod eftersom ärendet enligt bolaget inte nådde tröskeln för en ”omedelbar och trovärdig risk för allvarlig fysisk skada”. Det rapporterar The Independent med hänvisning till uppgifter som först publicerats av Wall Street Journal.

Den misstänkte, som identifieras som 18-årige Jesse Van Rootselaar, anklagas för att ha dödat familjemedlemmar och därefter genomfört en masskjutning på en skola i Tumbler Ridge i British Columbia innan han tog sitt liv, enligt The Independent. OpenAI säger att kontot stängdes av i juni 2025 för brott mot användarvillkoren och att bolaget senare, efter dådet, på eget initiativ kontaktade Royal Canadian Mounted Police med information som var relevant för utredningen.

Fox News, som också hänvisar till Wall Street Journal, tillägger att ett automatiserat granskningssystem flaggade interaktionerna och att ungefär ett dussin anställda kände till oroande innehåll – beskrivet som våldsskildringar med skjutvapenvåld under flera dagar – men att företaget ändå inte kontaktade polisen. OpenAI:s förklaring är en från innehållsgranskning: överrapportering skapar egna skadeverkningar, och att vara alltför snabb att koppla in rättsväsendet riskerar falska anklagelser och integritetskränkningar.

Tekniskt blottlägger episoden den svåra gränsen mellan ”fara” och ”handlingsgrundande risk”. En språkmodell kan skapa eller svara på våldsamma hypotetiska scenarier av många skäl: skönlitterärt skrivande, att få ur sig frustration, nyfikenhet, rollspel eller faktisk planering. Frågeloggar avslöjar inte avsikt; de är text. Även om man lägger till kringuppgifter (frekvens, stegring, önskemål om praktiska detaljer) återstår grundproblemet i statistiken: verkliga blivande gärningsmän är sällsynta, så ett system som ställs in för att fånga dem kommer att drunkna i falsklarm om det inte blir extraordinärt påträngande.

Därmed hamnar OpenAI – ett privat företag utan folkligt mandat – i en roll som i praktiken liknar hotbedömning, men utan möjligheter till tvångsmedel, utan rättssäkerhetsgarantier och utan demokratisk legitimitet. Bolagets tröskel (”omedelbar och trovärdig”) kan låta som en eftergift åt fri- och rättigheter, men fungerar också som ansvarshantering: tipsar man för tidigt blir man en privatiserad angiverilinje som kan förstöra liv; tipsar man för sent blir man skurken i efteranalysen.

Ett fungerande system för tidig varning skulle kräva två saker som den offentliga debatten gärna undviker. För det första: prövade och redovisade mått på träffsäkerhet – andel falsklarm och missade fall i realistiska populationer, inte tillrättalagda uppvisningar. För det andra: en tydlig styrningsmodell för när en privat plattform ska eskalera till statens tvångsmakt. Utan detta riskerar ”säkerhet kring artificiell intelligens” att bli en marknadsföringsetikett för en förbrottskedja – införd av företagens regelavdelningar, granskad av ingen, och motiverad i efterhand.

Det enda sättet att göra sådana system tillförlitligt förutsägande kan vara att utvidga övervakningen långt bortom samtalsloggar: koppla ihop identitet, enheter, plats, inköp och sociala nätverk. Med andra ord: förvandla en samtalsrobot till en informatör och nätet till ett allseende kontrollsystem. Då är frågan inte längre om modellen kan förutsäga våld. Frågan är om ett fritt samhälle ens bör vilja det.