Nytt CaP-X-test visar att språkmodeller skriver robotkod som ser rätt ut men misslyckas på riktigt

Nvidia och toppuniversitet jämför 12 avancerade modeller och ser ras när de tvingas bygga styrkedjan från grunden, lösningen blir inte större modeller utan mer mänskligt byggd stödinfrastruktur som någon måste granska

Bilder

Image description

the-decoder.com

Image description

the-decoder.com

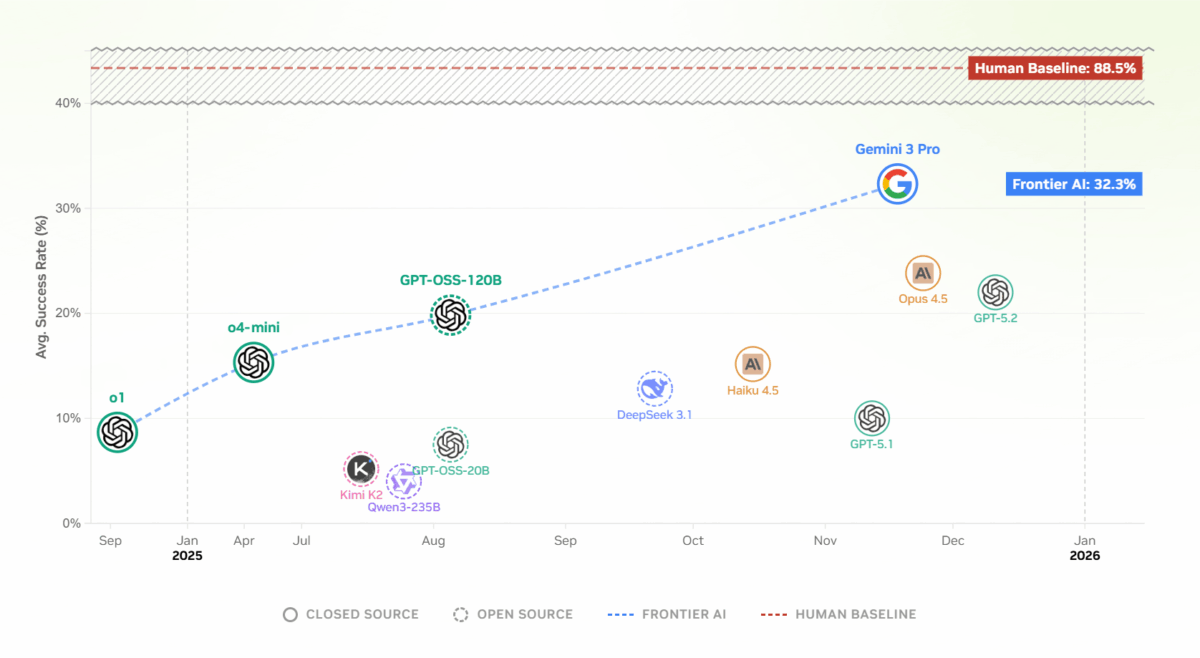

Even the strongest models tested fail at most robotics tasks when working without high-level abstractions.

the-decoder.com

Even the strongest models tested fail at most robotics tasks when working without high-level abstractions.

the-decoder.com

CaP-X sätter en siffra på ett robotproblem som hittills mest diskuterats i anekdoter: tolv ledande modeller för avancerad artificiell intelligens kan skriva robotstyrningskod som ser rimlig ut, men de kan inte pålitligt få verkliga maskiner att göra det koden avser vid första försöket.

Enligt The Decoder har forskare från Nvidia, University of California i Berkeley, Stanford och Carnegie Mellon byggt ett utvärderingsramverk kallat CaP-X. Det låter språkmodeller ta fram program för sju manipulationsuppgifter, från att lyfta en kub till tvåarmad samordning. Grundidén är medvetet enkel: i stället för att träna en robotstrategi från början till slut på stora rörelsedatamängder ska en allmän modell skriva styrlogiken. I praktiken visar studien att resultaten beror mindre på modellens ”intelligens” i abstrakt mening än på vilken programvarustomme modellen tillåts stå på.

De starkaste modellerna i jämförelsen – i rapporten nämns Gemini-3-Pro, GPT-5.2 och Claude Opus 4.5 – fungerar betydligt bättre när de får övergripande, människokonstruerade kommandon som ”grip föremål X och lyft det”. Tar man bort dessa abstraktioner och kräver att modellen själv sätter ihop kedjan av lägre nivåns byggstenar – bildsegmentering, djupuppskattning, greppplanering, koordinatomvandlingar, omvänd kinematik – faller träffsäkerheten ihop. En enda saknad omvandling eller en felaktig ramsignalering räcker för att ett program som ser korrekt ut ska resultera i en robot som sträcker sig fel, krockar eller stannar.

Ett av de mer motintuitiva resultaten är att det blir sämre när man matar in råa kamerabilder direkt i flermodala modeller. Forskarna förklarar detta med ett praktiskt anpassningsglapp: systemen tränas sällan för att samtidigt resonera om kodens riktighet och de fysiska följderna av att köra koden på verklig utrustning. CaP-X lägger i stället in en ”visuell differensmodul”, där en separat syn- och språkmodell omvandlar scenen till strukturerad text och efter varje försök beskriver vad som förändrats och om uppgiften är avslutad. Textbaserade tillståndssammanfattningar slår både konsollutskrifter och direkta bildinmatningar.

Artikelns föreslagna botemedel är inte en ny robotmodell utan ett arbetssätt. Lagets system ”CaP-Agent0” lägger tre mekanismer ovanpå befintliga modeller: återkoppling från perception till text via visuell differens; ett automatiskt uppbyggt bibliotek av hjälpfunktioner som skördas från lyckade körningar; samt parallell framtagning av lösningar, där nio kandidatprogram produceras och sedan sammanförs av en övervakande agent. Med denna stomme uppger forskarna att en agent utan träning kan närma sig mänsklig nivå på provuppgifterna.

Den omedelbara slutsatsen är att robotautonomi allt mer blir ett systemkonstruktions- och säkerhetsproblem snarare än en rak kapplöpning mot större modeller. Felen är inte exotiska: sköra beroenden, dolda antaganden i abstraktioner och svårigheten att validera kod som påverkar den fysiska världen. Ju mer förmåga som flyttas till samordning – verktygsanrop, hierarkisk planering, skyddsräcken och omtag – desto mer blir den avgörande frågan vem som granskar stommen, inte vilken modell som skrev första utkastet.

I CaP-X blir modellerna inte pålitliga av att se fler bildpunkter eller skriva längre kod. De blir pålitliga när uppgiften delas upp i delar som kan kontrolleras, köras om och gradvis återanvändas.