Studie kartlägger utvecklares klagomål på lågkvalitativt datorgenererat kodskräp

Heidelberg och Melbourne analyserar 1154 inlägg och finner att granskare och öppenkällkodsunderhållare får bära kostnaderna, den som klistrar in datorutdata spar tid medan ideella projekt tvingas strama åt när skräpet skalar

Bilder

Image description

the-decoder.com

Image description

the-decoder.com

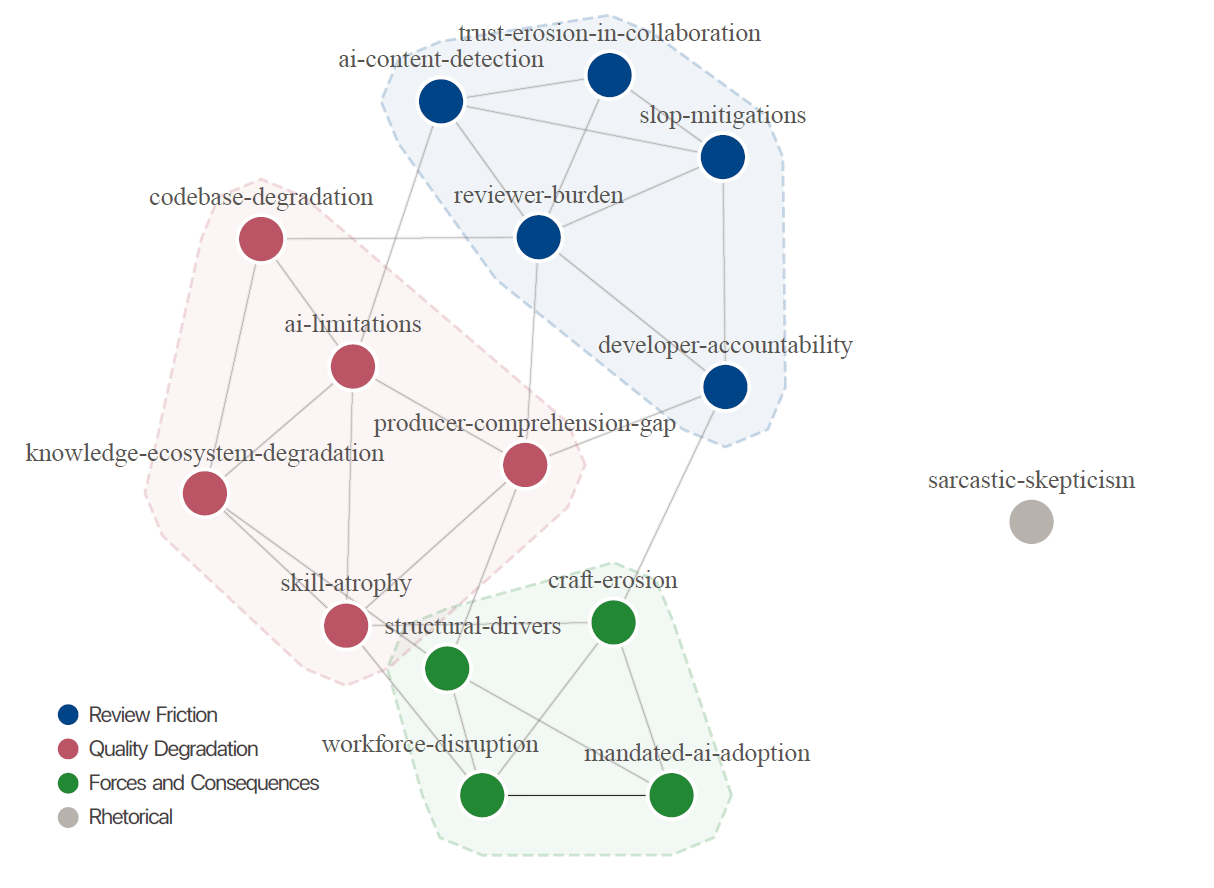

The study's 15 codes and their relationships, grouped into three thematic clusters: Review Friction (blue), Quality Degradation (pink), and Forces and Consequences (green). The isolated gray node "sarcastic-skepticism" runs as a rhetorical pattern across all topics. | Image: Baltes, Cheong, Treude (2026)

Baltes, Cheong, Treude (2026)

The study's 15 codes and their relationships, grouped into three thematic clusters: Review Friction (blue), Quality Degradation (pink), and Forces and Consequences (green). The isolated gray node "sarcastic-skepticism" runs as a rhetorical pattern across all topics. | Image: Baltes, Cheong, Treude (2026)

Baltes, Cheong, Treude (2026)

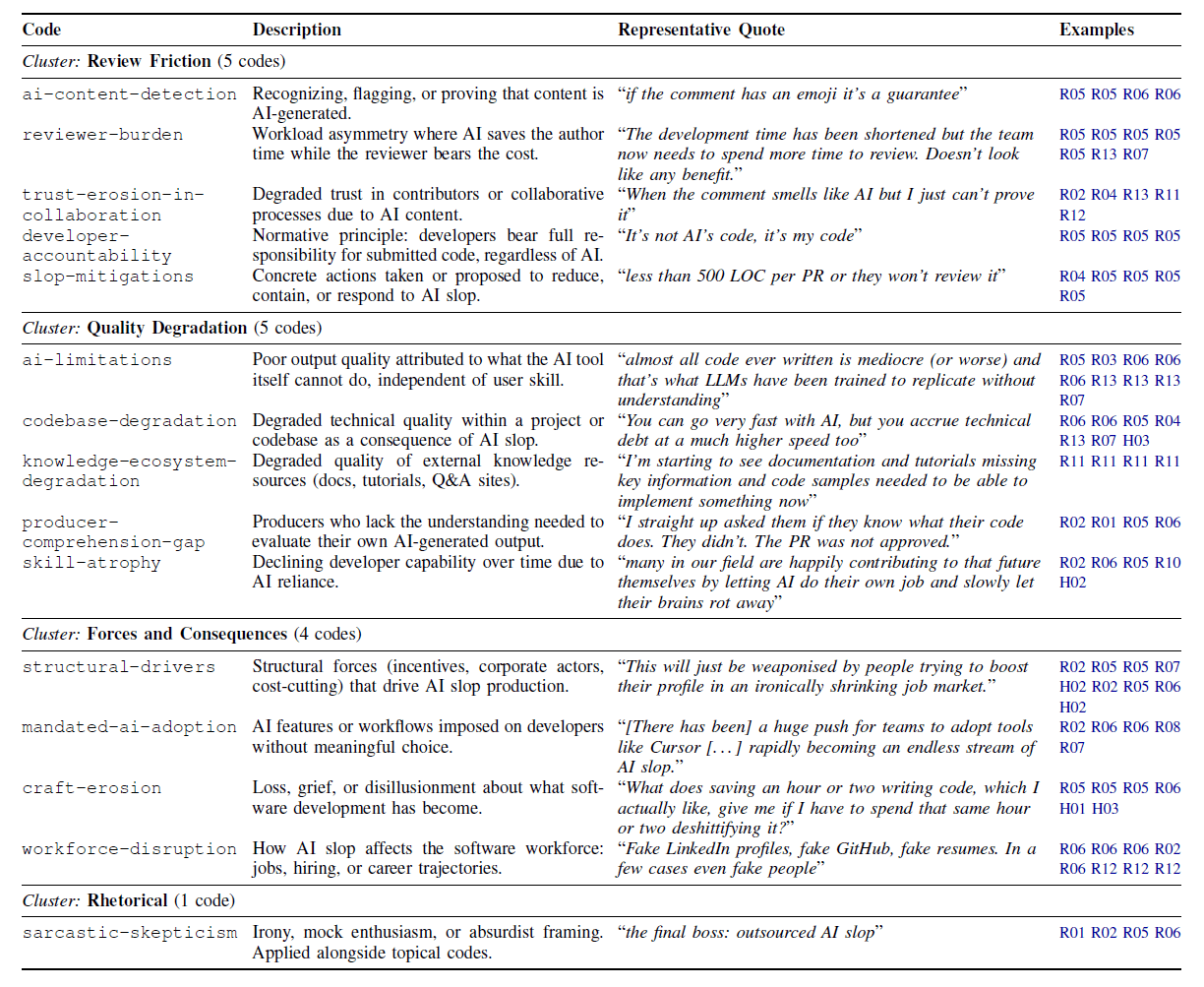

The full codebook with 15 categories, their descriptions, and representative quotes from the analyzed developer discussions. | Image: Baltes, Cheong, Treude (2026)

Baltes, Cheong, Treude (2026)

The full codebook with 15 categories, their descriptions, and representative quotes from the analyzed developer discussions. | Image: Baltes, Cheong, Treude (2026)

Baltes, Cheong, Treude (2026)

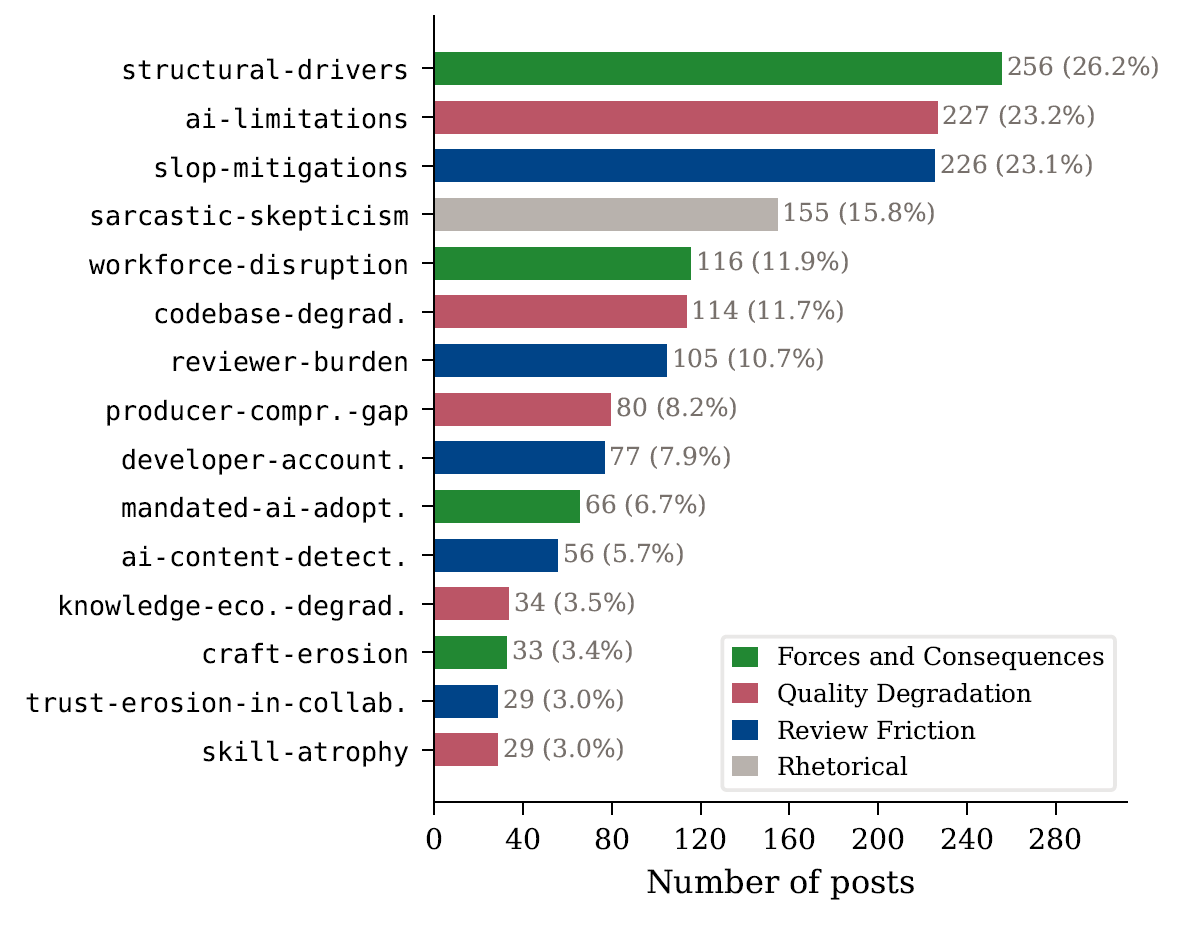

Structural drivers, AI limitations, and countermeasures dominate the discussion. Sarcastic skepticism is the fourth most common code at 15.8 percent. | Image: Baltes, Cheong, Treude (2026)

Baltes, Cheong, Treude (2026)

Structural drivers, AI limitations, and countermeasures dominate the discussion. Sarcastic skepticism is the fourth most common code at 15.8 percent. | Image: Baltes, Cheong, Treude (2026)

Baltes, Cheong, Treude (2026)

En ny kvalitativ studie som kartlägger utvecklares klagomål på ”AI-sörja” hävdar att lågkvalitativ kod som skapats med hjälp av AI vältrar över kostnaderna på granskare och förvaltare av öppen källkod, rapporterar The Decoder. Forskare vid Heidelbergs universitet, University of Melbourne och Singapore Management University analyserade 1 0154 inlägg i 15 trådar på Reddit och Hacker News där deltagarna uttryckligen diskuterade ”AI-sörja”, och ordnade återkommande argument i en kodbok som spänner över friktion i granskning, kvalitetsförsämring och följdverkningar längre ned i kedjan.

Studien är noggrann med vad den är – och inte är. Eftersom materialet byggdes genom att söka efter trådar som innehöll uttrycket ”AI-sörja” fångar den i huvudsak en självrekryterad grupp kritiker snarare än ett representativt urval av utvecklare. Den snedvridningen spelar roll: rapporten bör läsas som en strukturerad inventering av klagomål som redan cirkulerar, inte som en mätning av hur vanliga klagomålen är.

Ändå stämmer mönstret med vad många förvaltare säger privat: den som klistrar in AI-utdata får tidsvinsten, medan den som ska ta in ändringen, förvalta den och felsöka ärver risken. The Decoder lyfter ett centralt missnöje: AI-stöd kan korta den första utvecklingsfasen men förlänga granskningen, så att granskare i praktiken blir ”frågeformulerare” som måste gissa avsikten bakom generisk kod. I projekt med öppen källkod, där granskningsarbetet ofta är oavlönat, är obalansen mer än ett irritationsmoment – den blir en flaskhals för genomströmningen.

Rapporten kopplar klagomålen till konkreta exempel som redan syns i ekosystemet. The Decoder noterar att curl-projektet stängde sitt program med belöningar för felrapportering efter att ha översvämmats av AI-genererade sårbarhetsrapporter som åt upp förvaltarnas tid utan att ge giltiga fynd. Liknande problem har rapporterats av Apache Log4j 2 och spelmotorn Godot, där förvaltare och säkerhetsgrupper möter en växande volym bidrag med låg informationshalt. Resultatet blir en förutsägbar beteendeförändring: stramare bidragsregler, högre trösklar för nykomlingar och mer aggressiv filtrering – åtgärder som skyddar förvaltarnas tid men också kan minska den öppenhet som gjorde projekten värdefulla.

Studien beskriver också spridningseffekter på arbetsplatser. Utvecklare uppgav att AI-arbetssätt beordrades uppifrån, inklusive att chefer kopierade AI-utdata in i svar på tekniska problem. Den dynamiken kräver ingen illvilja; det räcker med en budgetansvarig som kan påstå produktivitetsvinster samtidigt som kontroll- och verifieringsbördan skjuts över på ingenjörer som inte har råd att ha fel.

Det nya här är inte att AI-genererad kod kan vara stökig, utan att stöket skalar. När verktyg gör utdata billigare blir granskningsuppmärksamhet den knappa resursen – och de projekt som inte kan ta betalt för den uppmärksamheten blir först med att ransonera den.